目录

摘要

一 语音情感识别的基本原理

语音信号的特征提取

情感状态的分类和识别

积极情感

消极情感

中性情感

语音情感识别的算法和模型

卷积神经网络(CNN)

长短期记忆网络(LSTM)

决策树(Decision Tree)

支持向量机(SVM)

二 Python语言在语音情感识别中的应用

使用python进行语音信号的处理和分析

Python语音情感识别库的介绍和应用

Python编程实现语音情感识别的基本算法

三 语音情感识别的应用场景

语音助手的情感识别和应用

电话客服的情感识别和应用

一、情感识别应用

二、举例说明

社交媒体的情感识别和应用

一、情感分析

二、情感交流

三、情感推荐

心理健康评测

四 实际测试和示例演示

流程图:

一、数据预处理

1. 读取CASIA情感数据库

2. 提取MFCCs特征

3. 零填充和转换为numpy数组

二、模型构建与训练

1. 构建卷积神经网络模型

2. 模型编译

3. 模型训练

三、结果评估与分析

1. 模型评估

2. 结果可视化

四、结论

五 语音情感识别发展前景

六 总结

一、引言

二、语音情感识别现状

三、语音情感识别前景

四、语音情感识别挑战

五、总结

七 源代码

声明

摘要

语音情感识别是一项研究人类语音中所蕴含情感信息的技术,用于识别和分析说话者语音中的情感状态,包括愉快、悲伤、愤怒、焦虑等。这项技术可以通过分析语音中的声调、语速、语音质量等特征来判断说话者的情感状态,从而帮助人们更好地理解和交流。

语音情感识别的发展情况可以追溯到20世纪80年代,当时研究人员开始尝试使用语音信号处理技术来识别说话者的情感状态。随着人工智能和机器学习技术的不断发展,语音情感识别技术也得到了长足的进步。现在,语音情感识别已经被广泛应用于语音助手、客服机器人、情感分析等领域。

目前,语音情感识别技术已经可以实现高准确度的情感识别,可以识别出说话者的情感状态,并据此做出相应的回应或处理。这项技术在商业、医疗、教育等领域都有着广泛的应用前景,可以帮助人们更好地理解和交流,提高人机交互的效率和舒适度。

随着人工智能和语音识别技术的不断发展,语音情感识别技术也将会得到进一步的改进和应用。

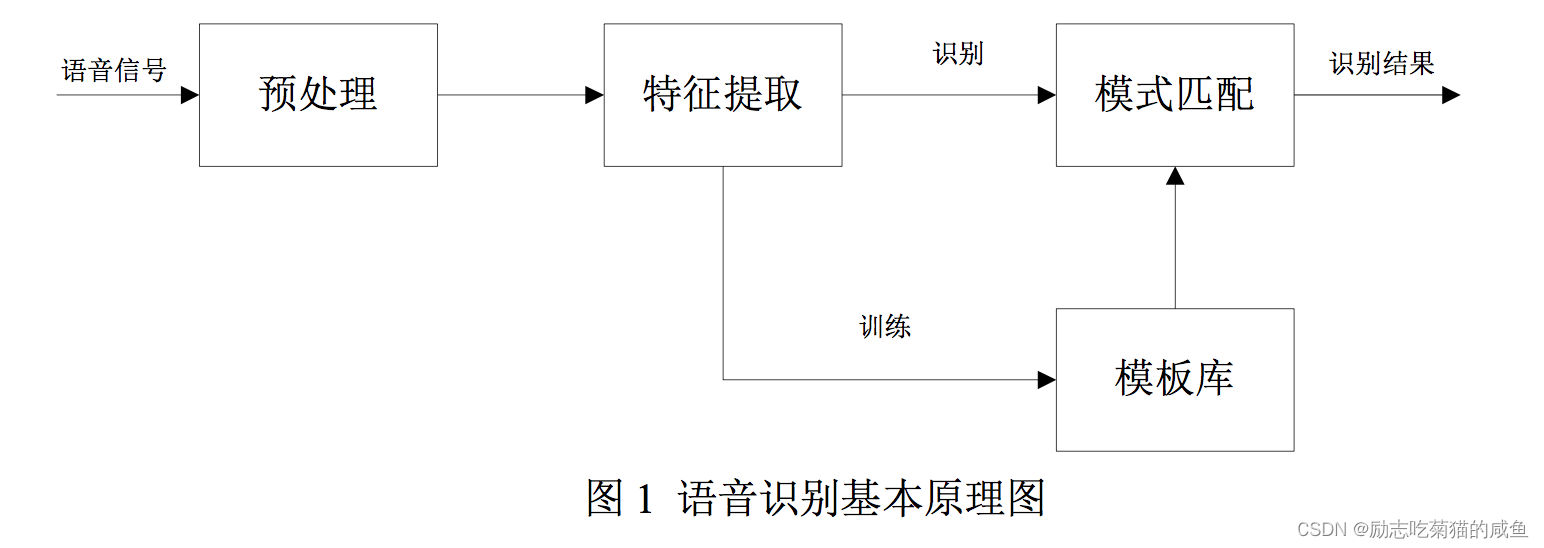

一 语音情感识别的基本原理

语音信号的特征提取

语音信号的特征提取是语音情感识别中的重要步骤之一,它通过对语音信号进行分析和处理,提取出能够表征语音信号特征的参数,为后续的情感识别提供依据。

首先,语音信号的特征提取需要将语音信号进行预处理,包括去除噪音、滤波、标准化等操作,以提高语音信号的清晰度和质量。

其次,特征提取需要对语音信号进行分解和分析,提取出能够表征情感的特征参数。这些参数可以包括频谱特征、倒谱系数、线性预测系数、梅尔频率倒谱系数等。其中,梅尔频率倒谱系数是一种基于人耳听觉特性的特征参数,能够很好地表征语音信号的音调和音色特征,因此在情感识别中经常被使用。

另外,一些新型的特征提取方法也被应用于语音情感识别中,如基于小波变换的特征提取、基于深度学习的特征提取等。这些方法能够更好地提取出语音信号中的细节信息和高层特征,从而提高情感识别的准确率和可靠性。

最后,特征提取还需要对提取出的特征参数进行归一化和量化,以消除不同特征之间的量纲和数量级的影响,保证后续情感识别的公正性和准确性。

总之,语音信号的特征提取是语音情感识别中的关键步骤之一,它通过对语音信号进行分析和处理,提取出能够表征情感的特征参数,为后续的情感识别提供依据。随着技术的不断发展和应用场景的不断扩展,特征提取技术也将不断进步和完善。

情感状态的分类和识别

语音情感识别是一种通过分析人类语音信号中的情感信息,实现对人类情感状态的自动识别和分类的技术。在语音情感识别中,情感状态通常可以分为以下几类:

积极情感

指积极的、愉快的、满意的情感状态,例如快乐、欣喜、愉快等。这种情感状态通常会伴随着欢快的语调、明亮的音色和较快的语速。在语音信号处理中,积极情感的特征通常表现为高频成分较多、能量较高、音色明亮等。

消极情感

指消极的、悲伤的、不满的情感状态,例如悲伤、沮丧、愤怒等。这种情感状态通常会伴随着低沉的语调、暗淡的音色和较慢的语速。在语音信号处理中,消极情感的特征通常表现为高频成分较少、能量较低、音色暗淡等。

中性情感

指没有明显情感倾向的情绪状态,例如平静、无情绪等。这种情感状态通常会伴随着正常的语调、中性的音色和正常的语速。在语音信号处理中,中性情感的特征通常表现为高频成分适中、能量适中、音色中性等。

在语音情感识别中,通常需要对以上三种情感状态进行分类和识别。这可以通过对语音信号进行特征提取和模式分类来实现。常用的特征提取方法包括短时傅里叶变换、梅尔频率倒谱系数等,常用的模式分类方法包括支持向量机、朴素贝叶斯分类器、深度学习模型等。通过对语音信号的特征提取和模式分类,可以实现对人类情感状态的自动识别和分类。

在实际应用中,语音情感识别技术可以帮助我们更好地了解人类的情感状态和需求,从而提供更加个性化的服务和解决方案。例如,在智能客服中,通过语音情感识别技术可以判断用户的心情和满意度,从而提供更加贴心的服务和解决方案;在智能家居中,通过语音情感识别技术可以自动调整室内温度、照明等参数,提供更加舒适的生活环境;在医疗健康领域,通过语音情感识别技术可以帮助医生更好地了解病人的情感状态和需求,从而提供更加个性化的治疗方案。

语音情感识别的算法和模型

语音情感识别是一种复杂的任务,需要使用多种算法和模型来实现。下面将介绍一些常用的语音情感识别算法和模型,并举例说明它们的应用。

卷积神经网络(CNN)

CNN是一种深度学习算法,适用于处理图像和语音信号等多媒体数据。在语音情感识别中,CNN可以用来提取语音信号的特征,并分类情感类别。例如,使用CNN模型对预处理后的语音信号进行卷积、池化等操作,从而提取出情感相关的特征,再使用分类器进行情感分类。

长短期记忆网络(LSTM)

LSTM是一种循环神经网络,适用于处理序列数据,如语音信号。在语音情感识别中,LSTM可以用来对语音信号进行时间序列分析,提取出情感相关的特征,并预测情感类别。例如,使用LSTM模型对预处理后的语音信号进行训练和预测,根据预测结果来分类情感。

决策树(Decision Tree)

决策树是一种常见的分类算法,适用于分类多种类型的数据。在语音情感识别中,决策树可以用来对语音信号进行分类,根据不同的特征进行决策,从而实现对情感的识别。例如,使用决策树模型对预处理后的语音信号进行分类,根据不同的特征进行决策,从而实现对情感的识别。

支持向量机(SVM)

SVM是一种监督学习算法,适用于分类二类或多类数据。在语音情感识别中,SVM可以用来对语音信号进行分类,根据不同的特征进行决策,从而实现对情感的识别。例如,使用SVM模型对预处理后的语音信号进行分类,根据不同的特征进行决策,从而实现对情感的识别。

总之,语音情感识别需要使用多种算法和模型来实现。不同的算法和模型具有不同的特点和应用场景,需要根据具体的应用需求选择合适的算法和模型来实现对情感的识别。

二 Python语言在语音情感识别中的应用

使用python进行语音信号的处理和分析

在语音情感识别中,Python是一种常用的编程语言,它具有简单易学、功能强大、可扩展性高等优点,因此被广泛应用于语音信号处理和分析领域。下面我们将详细介绍如何使用Python进行语音信号的处理和分析。

首先,我们需要使用Python中的音频处理库来读取和处理音频文件。其中,最常见的是使用pydub库和librosa库。pydub库是一个简单易用的音频处理库,可以用来读取、剪辑、转换音频文件等操作。librosa库则是一个专门用于音乐和音频分析的Python库,可以用来提取音频特征、进行音频分析等操作。

在读取和处理音频文件时,我们需要先将音频文件转换为可以处理的信号。这一步通常使用pydub库中的函数来实现。例如,我们可以使用pydub中的AudioSegment函数来读取音频文件,并将其转换为数字信号。同时,我们还可以使用AudioSegment函数中的各种方法来对信号进行剪辑、转换等操作。

在对信号进行处理之后,我们需要使用各种算法来提取信号的特征。这些特征可以包括短时傅里叶变换(STFT)、梅尔频率倒谱系数(MFCC)等。这些特征可以反映出语音信号的频谱特征和时间动态特征,从而帮助我们实现对语音情感的识别和分类。

最后,我们需要使用机器学习算法来对提取出的特征进行分类和识别。这一步通常使用scikit-learn库中的函数来实现。例如,我们可以使用scikit-learn中的SVM(支持向量机)算法来对提取出的特征进行分类和识别,从而实现语音情感的识别和分类。

总之,使用Python进行语音信号的处理和分析是一个复杂的过程,需要涉及到多个步骤和多种技术。但是,通过不断地实践和探索,我们可以不断提高语音情感识别的准确率和可靠性,从而为人们的生活和工作带来更多的便利和效益。

Python语音情感识别库的介绍和应用

Python语音情感识别库是一种基于Python语言的语音情感识别工具,它可以帮助开发者快速实现语音情感识别功能。该库提供了多种功能,包括音频采集、预处理、特征提取、模型训练和预测等,可以实现对人类情感的高精度识别和分类。

Python语音情感识别库的应用场景非常广泛,例如在智能客服领域,可以使用该库来实现对用户情感的分析和分类,从而提供更加贴心和个性化的服务。在智能家居领域,可以使用该库来实现对家庭成员情感的分析和监测,从而自动调整家居设备参数,提供更加舒适的生活环境。此外,在情感健康领域,也可以使用该库来实现对人类情感的分析和监测,从而帮助人们更好地了解自己的情感状态和需求。

Python语音情感识别库的具体作用包括:

音频采集:该库可以实现对语音信号的采集和预处理,从而提取出有效的音频特征。特征提取:该库可以通过对音频信号进行分析和处理,提取出反映人类情感的特征向量。模型训练和预测:该库可以通过对提取出的特征向量进行训练和分类,实现对人类情感的识别和分类。情感标签:该库可以将识别出的情感标签化为人类可读的形式,从而方便人们更好地了解自己的情感状态和需求。例如,在智能客服领域,可以使用Python语音情感识别库来实现对用户情感的分析和分类。当用户打电话或在线咨询时,客服系统可以通过该库来采集用户的语音信号,并对其进行预处理和特征提取。然后,该库可以通过对提取出的特征向量进行训练和分类,实现对用户情感的高精度识别和分类。最后,该库可以将识别出的情感标签化为人类可读的形式,从而方便客服人员更好地了解用户的需求和情绪,提供更加贴心和个性化的服务。

Python编程实现语音情感识别的基本算法

Python编程实现语音情感识别的基本算法包括以下几种:

基于信号处理的方法:该方法主要是通过信号处理技术,提取语音信号中的特征,例如频谱特征、倒谱特征等,然后利用分类器对这些特征进行分类,从而实现语音情感识别。常用的分类器包括支持向量机(SVM)、决策树(Decision Tree)、朴素贝叶斯(Naive Bayes)等。这种算法通常需要大量的带标签数据进行训练,精度较高,适合在实验室环境下进行研究和测试。基于深度学习的方法:该方法主要是通过深度神经网络对语音信号进行自动编码和特征提取,从而实现对语音情感的识别。常用的深度神经网络包括循环神经网络(RNN)、卷积神经网络(CNN)、长短时记忆网络(LSTM)等。深度学习方法的优点是不需要手工提取特征,可以直接对原始语音信号进行建模,并且可以自动学习到一些复杂的情感特征。但是,深度学习方法需要大量的带标签数据进行训练,并且模型的复杂度较高,需要较高的计算资源和时间成本。基于集成学习的方法:该方法主要是将多个分类器集成在一起,从而实现对语音情感的准确识别。常用的集成学习算法包括Bagging、Boosting等。集成学习方法的优点是可以提高分类器的准确性和鲁棒性,并且可以降低过拟合的风险。但是,集成学习方法需要较多的计算资源和时间成本,并且需要手动选择合适的基分类器和集成策略。在应用场景方面,基于信号处理的语音情感识别算法常用于实验室研究和原型系统开发;基于深度学习的语音情感识别算法常用于实际生产和商业化应用;基于集成学习的语音情感识别算法则可以根据实际需求进行灵活的应用。

以智能客服为例,可以使用基于信号处理的语音情感识别算法来实现对用户情感的分析和分类。通过对用户语音信号进行预处理和特征提取,可以利用支持向量机(SVM)、决策树(Decision Tree)等分类器对这些特征进行分类,从而判断用户的情感状态和需求。根据用户的情感状态和需求,智能客服系统可以自动调整服务策略,提供更加贴心和个性化的服务。

三 语音情感识别的应用场景

语音助手的情感识别和应用

随着人工智能技术的不断发展,语音助手作为一种智能化的交互方式,已经逐渐融入了我们的日常生活。其中,情感识别技术是语音助手的重要组成部分,它可以帮助语音助手更好地理解用户的情感和需求,从而提供更加个性化、高效的服务。

语音助手的情感识别是指通过语音助手来识别用户的情感和情绪状态,从而判断用户的心情、满意度等。这种情感识别技术可以应用于各种领域,例如智能客服、智能家居、车载语音助手等。

在智能客服领域,语音助手的情感识别技术可以帮助企业更好地了解用户的需求和情绪,从而提供更加贴心、个性化的服务。例如,当用户打电话或在线咨询时,客服系统可以通过语音助手的情感识别技术来采集用户的语音信号,并对其进行预处理和特征提取。然后,该技术可以通过对提取出的特征向量进行训练和分类,实现对用户情感的高精度识别和分类。最后,该技术可以将识别出的情感标签化为人类可读的形式,从而方便客服人员更好地了解用户的需求和情绪,提供更加贴心和个性化的服务。

除了智能客服领域,语音助手的情感识别技术还可以应用于智能家居领域。例如,当智能家居设备接收到用户的语音指令时,语音助手的情感识别技术可以帮助设备更好地了解用户的需求和情绪,从而自动调整设备参数,提供更加舒适、智能化的生活环境。

总之,语音助手的情感识别技术是人工智能技术中的重要组成部分,它可以广泛应用于各种领域,帮助人们更好地了解用户的需求和情绪,提供更加个性化、高效的服务。随着技术的不断进步和应用场景的不断扩展,语音助手的情感识别技术将会得到更加广泛的应用和推广。

电话客服的情感识别和应用

语音情感识别是指通过分析语音信号中的情感因素,将人类情感转化为机器可理解的数据。在电话客服中,语音情感识别可以帮助企业更好地了解客户情感,提高客户满意度和忠诚度。

一、情感识别应用

客户情绪分析

电话客服中的情感识别可以帮助企业分析客户的情绪状态,如是否愉悦、生气、沮丧等。通过对大量客户电话录音进行情感分析,企业可以挖掘出客户的需求和痛点,从而更好地改进产品和服务。

客服人员表现评估

情感识别技术还可以用于评估客服人员的表现。通过对客服人员与客户的沟通录音进行分析,可以了解客服人员是否能够有效地解决客户问题,以及他们的服务态度和语气是否得当。这样可以为企业提供客观、量化的评价标准,帮助企业选拔和培养优秀的客服人员。

二、举例说明

假设一家电商网站的电话客服团队遇到了以下问题:客户投诉率居高不下,客户对客服人员的服务态度和服务质量不满意。为了解决这些问题,企业决定引入语音情感识别技术。

数据收集与分析

企业首先收集了大量客户电话录音,并使用情感识别技术对这些录音进行分析。通过分析,企业发现客户投诉的主要原因是等待时间过长、客服人员回答不准确、服务态度不好等。同时,企业还发现一些客服人员在处理客户问题时表现出不耐烦、消极怠工等不良情绪。

制定改进措施

针对这些问题,企业采取了以下措施:优化电话排队系统,减少客户等待时间;加强客服人员的培训,提高他们的业务水平和沟通能力;针对服务态度不好的客服人员开展专项整治行动,提高整个团队的服务质量。

效果评估与持续改进

经过一段时间的实施,企业再次使用情感识别技术对电话客服团队的表现进行分析。结果显示,客户投诉率明显下降,客户满意度明显提高。同时,客服人员的服务态度和服务质量也得到了明显改善。

社交媒体的情感识别和应用

语音情感识别是一种人工智能技术,可以通过分析语音中的情感信息来识别说话人的情感状态。在社交媒体中,语音情感识别技术可以用于情感分析、情感交流、情感推荐等多个方面。

一、情感分析

情感分析是社交媒体中重要的一环,通过对文本、语音等信息的情感倾向进行分析,可以了解用户对某个事件或产品的看法和态度。语音情感识别技术可以用于情感分析,通过分析说话人的语音情感信息,判断其情感倾向是正面还是负面。例如,在新闻评论、产品评价等场景中,可以通过语音情感识别技术来判断用户对新闻或产品的态度是积极还是消极,从而为媒体或企业提供更为精准的舆情分析和市场调研。

二、情感交流

社交媒体是一个交流的平台,用户可以通过文字、语音等方式进行交流。语音情感识别技术可以用于情感交流,通过分析说话人的语音情感信息,判断其情感状态和情绪变化,从而更好地理解用户的意图和需求。例如,在智能客服中,可以通过语音情感识别技术来判断用户的心情和问题类型,从而提供更为精准的解决方案和更好的服务体验。

三、情感推荐

社交媒体中有很多推荐系统,可以根据用户的兴趣和行为来推荐相关的内容。语音情感识别技术可以用于情感推荐,通过分析用户的语音情感信息,判断其兴趣和喜好,从而为用户推荐更为精准的内容。例如,在音乐播放器中,可以通过语音情感识别技术来判断用户的音乐喜好和心情状态,从而为用户推荐更适合的音乐。

总之,语音情感识别技术在社交媒体中有着广泛的应用前景,可以帮助企业更好地了解用户需求和市场情况,提高产品和服务的质量和竞争力。同时也可以帮助用户更好地沟通和交流,提高社交媒体的互动性和用户体验。

心理健康评测

语音情感识别是一种人工智能技术,能够通过分析语音中的情感信息来识别说话人的情感状态。这种技术已经被广泛应用于心理健康评测领域,为心理医生、心理咨询师和患者提供了更加便捷和准确的心理健康评测工具。

在心理健康评测领域,语音情感识别技术主要被用于以下几个方面:

抑郁检测:语音情感识别技术可以通过分析说话人的语音中的情感信息,判断其是否患有抑郁症。例如,语音中的悲伤、沮丧、无助等负面情感信息越多,就越有可能患有抑郁症。通过语音情感识别技术,心理医生可以更加准确地诊断抑郁症患者,并为他们提供更加个性化的治疗方案。焦虑检测:焦虑症患者通常会出现语音中的紧张、焦虑、不安等情感信息。语音情感识别技术可以通过分析这些情感信息来检测焦虑症。例如,在考试前夕,学生可能会出现语音中的紧张和焦虑情感信息,通过语音情感识别技术可以检测出这些信息,提醒学生需要注意放松和调整心态。自闭症辅助诊断:自闭症患者通常会出现语音中的情感淡漠、语言障碍等问题。通过语音情感识别技术,可以分析自闭症患者的语音中的情感信息,帮助他们更好地表达自己的情感和需求。精神分裂症辅助诊断:精神分裂症患者通常会出现语音中的幻听、妄想等异常症状。通过语音情感识别技术,可以分析精神分裂症患者的语音中的情感信息,帮助他们更好地理解自己的病情并接受治疗。总之,语音情感识别技术在心理健康评测领域具有广泛的应用前景,可以为心理医生、心理咨询师和患者提供更加便捷和准确的心理健康评测工具。随着人工智能技术的不断发展,这种技术的应用范围也将不断扩大。

四 实际测试和示例演示

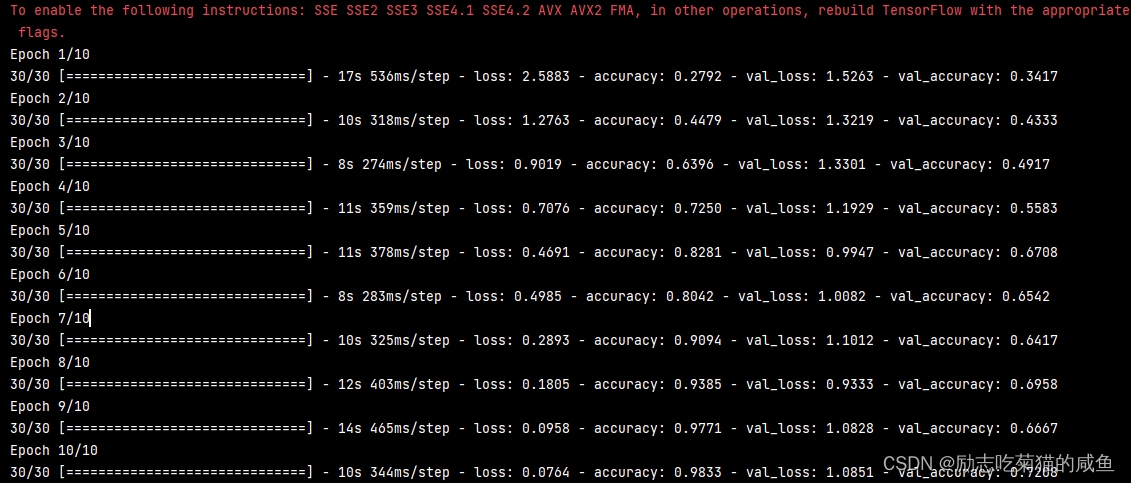

利用卷积神经网络(CNN)对CASIA情感数据库进行语音情感识别的方法。提取了Mel频率倒谱系数(MFCCs)作为音频特征,并使用Keras库构建了一个卷积神经网络模型,以实现对六类基本情绪(愤怒、恐惧、快乐、中性、悲伤和惊讶)的分类。

CASIA数据库链接:

https://pan.baidu.com/s/11Kd3yQ7_unRw87NGp4TaCA?pwd=uj92

流程图:

一、数据预处理

1. 读取CASIA情感数据库

首先设置了一个变量"data_path",指向了CASIA数据库的路径。然后定义了一个包含6种基本情绪的列表"emotions"。

代码:

# 读取CASIA数据集data_path = 'D:\CASIA\datatest'emotions = ['angry', 'fear', 'happy', 'neutral', 'sad', 'surprise']X = []y = []

2. 提取MFCCs特征

对于每个文件,使用Librosa库加载音频信号,并计算40维MFCCs作为音频特征。提取的MFCCs是一个二维数组(时间步长x特征维度)。

代码:

for emotion in emotions: files = os.listdir(os.path.join(data_path, emotion)) for file in files: file_path = os.path.join(data_path, emotion, file) y.append(emotion) signal, sr = librosa.load(file_path, sr=None) mfccs = librosa.feature.mfcc(y=signal, sr=sr, n_mfcc=40) X.append(mfccs.T)

3. 零填充和转换为numpy数组

由于不同样本的MFCCs序列长度不一致,需要将所有序列调整为相同的长度。为此,采用了零填充的方式,将较短的序列补足到最长序列的长度。最后,将所有的MFCCs特征存储在列表X中,对应的标签存储在列表y中。

代码:

max_length = max(len(mfcc) for mfcc in X)X_padded = [np.pad(mfcc, ((0, max_length - len(mfcc)), (0, 0)), mode='constant') for mfcc in X]X = np.array(X_padded)y = pd.get_dummies(y)二、模型构建与训练

1. 构建卷积神经网络模型

使用Keras库构建了一个卷积神经网络模型。该模型包含3个卷积层,每个卷积层后面跟着一个最大池化层。卷积层用于从输入数据中提取局部特征,而最大池化层则用于降低模型复杂度并提高泛化能力。全连接层用于将提取的特征映射到输出类别上。

代码:

# 构建卷积神经网络模型model = models.Sequential([ layers.Conv2D(32, (3, 3), activation='relu', input_shape=(X.shape[1], X.shape[2], 1)), layers.MaxPooling2D((2, 2)), layers.Conv2D(64, (3, 3), activation='relu'), layers.MaxPooling2D((2, 2)), layers.Conv2D(128, (3, 3), activation='relu'), layers.MaxPooling2D((2, 2)), layers.Flatten(), layers.Dense(128, activation='relu'), layers.Dense(len(emotions), activation='softmax')])2. 模型编译

使用Adam优化器进行参数更新,交叉熵损失函数作为损失函数,以及准确率作为评估指标。

代码:

model.compile(optimizer='adam', loss='categorical_crossentropy', metrics=['accuracy'])3. 模型训练

使用train_test_split函数将数据集划分为训练集和测试集,分别占80%和20%,然后对模型进行了10轮的训练。

代码:

# 训练模型model.fit(X_train, y_train, epochs=10, batch_size=32, validation_data=(X_test, y_test))

结果:

三、结果评估与分析

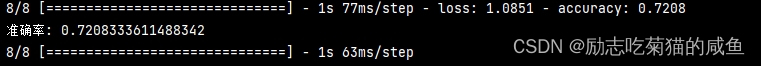

1. 模型评估

使用model.evaluate方法对测试集进行了评估,得到了模型的准确率。

代码:

# 评估模型accuracy = model.evaluate(X_test, y_test)[1]print('准确率:', accuracy)# 使用模型进行预测predictions = model.predict(X_test)predicted_emotions = [emotions[np.argmax(pred)] for pred in predictions]结果:

2. 结果可视化

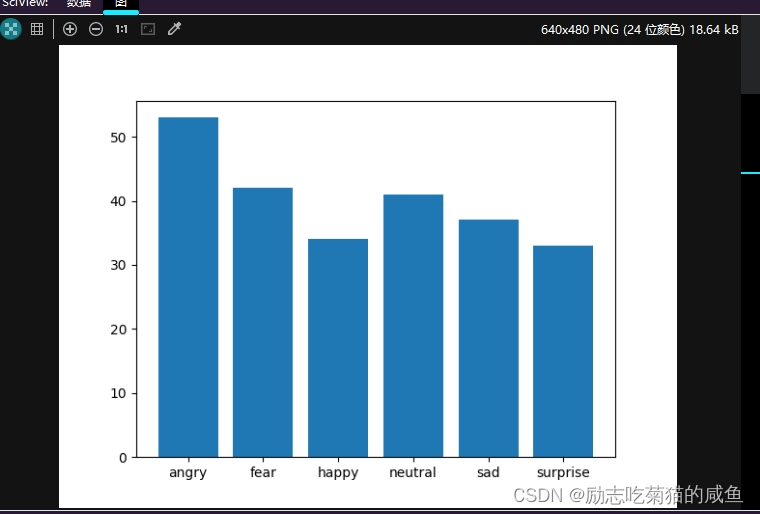

还绘制了一个条形统计图,展示了每种情感的预测数量。这有助于了解模型对于各种情感的识别效果。

代码:

# 绘制六维图import matplotlib.pyplot as pltfig, ax = plt.subplots()emotions_count = [predicted_emotions.count(emotion) for emotion in emotions]ax.bar(emotions, emotions_count)plt.show()结果:

四、结论

这种基于卷积神经网络的语音情感识别系统,尽管取得了较高的识别精度,但仍有提升空间,在精度上面没有达到最佳,还可以尝试不同的特征提取方法或改进模型结构。未来的研究还可以探索如何将此系统应用于实际应用场景,如智能客服、虚拟助手等。数据测试结果如上所示,所测结果一切正常顺利

五 语音情感识别发展前景

语音情感识别是一种利用人工智能技术分析语音中的情感信息,以识别说话人的情感状态的技术。随着人工智能技术的不断发展和普及,语音情感识别技术也在逐渐被应用于更多的领域,展现出广阔的发展前景。

首先,在心理健康领域,语音情感识别技术可以为心理医生、心理咨询师和患者提供更加便捷和准确的心理健康评测工具。通过语音情感识别技术,可以快速、准确地检测出患者的情感状态,帮助医生更好地诊断病情并为患者提供个性化的治疗方案。同时,语音情感识别技术还可以为心理咨询师提供技术支持,帮助他们更好地了解患者的情感状态和需求,为患者提供更加有效的心理辅导。

其次,语音情感识别技术还可以应用于教育领域。在教育领域,教师可以通过语音情感识别技术来分析学生的学习状态和情感需求,为每个学生提供更加个性化的教学方案。同时,语音情感识别技术还可以帮助教师更好地了解学生的情感表达和沟通方式,帮助学生更好地理解和掌握知识。

此外,语音情感识别技术还可以应用于人机交互领域。在人机交互领域,语音情感识别技术可以帮助机器更好地理解人类用户的需求和意图,提高人机交互的效率和自然性。例如,语音助手可以通过分析用户的语音情感信息来更好地理解用户的需求和意图,为用户提供更加个性化、高效的服务。

然而,语音情感识别技术现在也面临着一些问题。首先,语音情感识别技术的准确性受到多种因素的影响,如说话人的口音、语速、音量等。因此,为了提高语音情感识别技术的准确性,需要不断优化算法和完善数据集。其次,语音情感识别技术还需要解决隐私保护的问题。在分析语音数据时,需要确保数据的安全性和隐私性,避免数据被泄露和滥用。

六 总结

一、引言

随着人工智能技术的快速发展,语音情感识别技术逐渐成为研究热点。语音情感识别是指通过分析语音信号中的特征,识别出说话人的情感状态,例如快乐、悲伤、愤怒等。这项技术不仅在心理学领域具有广泛的应用价值,还在商业、安全等领域具有潜在的应用前景。本报告将对语音情感识别的现状、前景及挑战进行深入分析和总结。

二、语音情感识别现状

目前,语音情感识别技术已经取得了一定的研究成果。在特征提取方面,研究人员提出了一系列有效的特征参数,如梅尔频率倒谱系数(MFCC)、线性预测编码(LPC)等,这些特征可以有效地表达语音信号中的情感信息。在模型构建方面,深度学习算法在语音情感识别中取得了显著的成果,如循环神经网络(RNN)、卷积神经网络(CNN)和长短期记忆网络(LSTM)等。这些模型可以自动提取语音信号中的特征,并且可以有效地进行情感分类。

此外,现有的研究还发现,语音情感识别在特定领域的应用中表现出较高的准确率,如客户服务、心理咨询等。在实际应用方面,一些公司已经开发出了基于语音情感识别的产品,如微软的“Microsoft Azure Emotion API”和苹果的“Siri”。这些产品可以识别用户的情感状态,并据此进行相应的回应或服务。

三、语音情感识别前景

虽然语音情感识别技术已经取得了一定的成果,但还有很多潜在的应用前景。以下是几个可能的领域:

智能家居:未来的智能家居系统可以结合语音情感识别技术,根据家庭成员的情感状态进行智能调节,例如调整室内温度、播放舒缓音乐等。自动驾驶:在自动驾驶汽车中引入语音情感识别技术,可以根据驾驶员的情感状态进行相应的驾驶辅助,例如提醒驾驶员注意安全、自动调整车内氛围等。健康医疗:通过监测患者的语音情感状态,可以帮助医生更好地了解患者的病情和心理状况,从而进行更有效的治疗。教育领域:在在线教育中引入语音情感识别技术,可以根据学生的情感状态进行个性化教学,例如判断学生的学习状态、提供相应的学习建议等。四、语音情感识别挑战

尽管语音情感识别具有广泛的应用前景,但仍存在一些挑战和问题。以下是几个主要的挑战:

跨语言和跨文化差异:不同语言和文化背景下的语音情感表达方式存在差异,这给跨语言的语音情感识别带来了困难。因此,需要针对不同语言和文化背景开发更加鲁棒的语音情感识别系统。隐私保护:语音情感识别涉及到用户的个人隐私信息,如何保证数据安全和隐私保护是亟待解决的问题。需要在技术和法律层面加强保障措施,确保用户的隐私不被侵犯。技术成本:目前,语音情感识别技术的实现需要大量的计算资源和专业的技术人员支持,这使得技术成本较高。未来需要进一步降低技术成本,使其适用于更多的应用场景。技术可靠性:虽然现有的语音情感识别技术取得了一定的成果,但在某些场景下仍存在误判和可靠性问题。例如,对于一些口音、语速以及环境噪音等因素的干扰,目前的语音情感识别技术还难以完全克服。因此,需要进一步研究和改进技术可靠性问题。五、总结

语音情感识别技术具有广泛的应用前景和潜在价值,但同时也面临着诸多挑战和问题。未来需要进一步加大研究力度和投入,推动技术的不断进步和完善。同时,也需要关注隐私保护等技术伦理问题以及相关的法律和社会问题。随着技术的不断发展和完善,相信语音情感识别将在更多的领域得到广泛应用并发挥重要作用。

七 源代码

import numpy as npimport pandas as pdimport librosaimport osfrom sklearn.model_selection import train_test_split# import tensorflow as tf# from tensorflow.keras import layers, models# 读取CASIA数据集data_path = 'D:\CASIA\datatest'emotions = ['angry', 'fear', 'happy', 'neutral', 'sad', 'surprise']X = []y = []for emotion in emotions: files = os.listdir(os.path.join(data_path, emotion)) for file in files: file_path = os.path.join(data_path, emotion, file) y.append(emotion) signal, sr = librosa.load(file_path, sr=None) mfccs = librosa.feature.mfcc(y=signal, sr=sr, n_mfcc=40) X.append(mfccs.T)max_length = max(len(mfcc) for mfcc in X)X_padded = [np.pad(mfcc, ((0, max_length - len(mfcc)), (0, 0)), mode='constant') for mfcc in X]X = np.array(X_padded)y = pd.get_dummies(y)# 划分训练集和测试集X_train, X_test, y_train, y_test = train_test_split(X, y, test_size=0.2, random_state=42)from keras import layers, models# 构建卷积神经网络模型model = models.Sequential([ layers.Conv2D(32, (3, 3), activation='relu', input_shape=(X.shape[1], X.shape[2], 1)), layers.MaxPooling2D((2, 2)), layers.Conv2D(64, (3, 3), activation='relu'), layers.MaxPooling2D((2, 2)), layers.Conv2D(128, (3, 3), activation='relu'), layers.MaxPooling2D((2, 2)), layers.Flatten(), layers.Dense(128, activation='relu'), layers.Dense(len(emotions), activation='softmax')])model.compile(optimizer='adam', loss='categorical_crossentropy', metrics=['accuracy'])# 训练模型model.fit(X_train, y_train, epochs=10, batch_size=32, validation_data=(X_test, y_test))# 评估模型accuracy = model.evaluate(X_test, y_test)[1]print('准确率:', accuracy)# 使用模型进行预测predictions = model.predict(X_test)predicted_emotions = [emotions[np.argmax(pred)] for pred in predictions]# 绘制六维图import matplotlib.pyplot as pltfig, ax = plt.subplots()emotions_count = [predicted_emotions.count(emotion) for emotion in emotions]ax.bar(emotions, emotions_count)plt.show()声明

郑重声明!!!!此代码只是一个简单的语音情感识别检测的示例,实验过程中用到的语音数据集只是一个极小的数据库,非大型数据集,所以会存在运行简单,效率不高等情况,有任何问题请求指正!!!