本期将给大家介绍22个与手部检测、手势识别、手部图像分割等任务相关的公开数据集,包含第一人称、第三人称视角,可用于人机交互、手语翻译、3D建模等场景。

手部数据集清单一览:

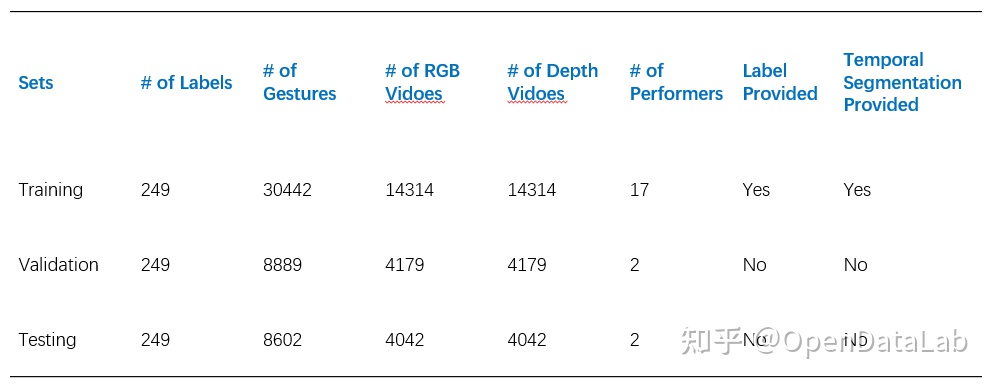

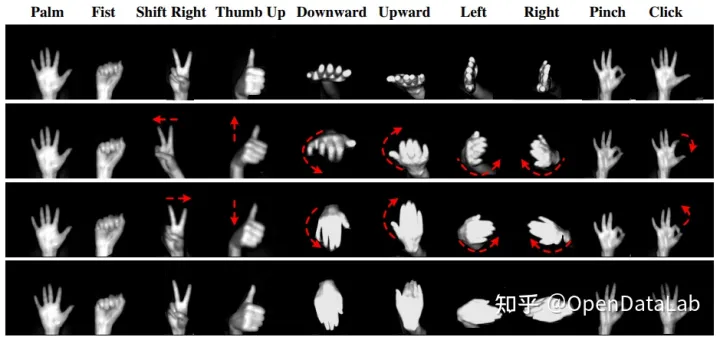

Chalearn ConGD(the Continuous Gesture Dataset)是一个大规模的连续手势识别数据集。该数据库包含 22535 个 RGB-D 手势视频(约 4G)中的 47933 个 RGB-D 手势。每个 RGB-D 视频可能代表一个或多个手势,共有 249 个手势标签,由 21 个不同的人执行。

为了使用方便,数据库被分成了三个子数据集,这三个子集是互斥的。

● 下载地址:

https://gesture.chalearn.org/2016-looking-at-people-cvpr-challenge/isogd-and-congd-datasets

● 论文地址:

http://www.cbsr.ia.ac.cn/users/jwan/papers/CVPRW2016_JunWan.pdf

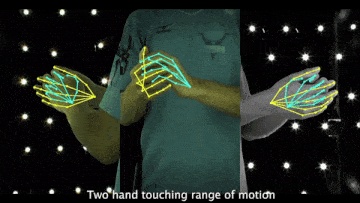

4 HandNet

● 发布方:以色列理工学院计算机科学学院GIP实验室

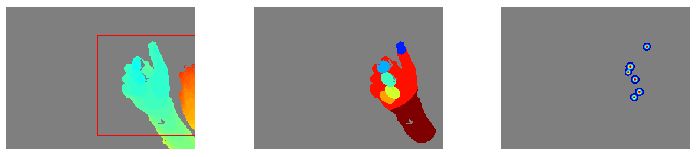

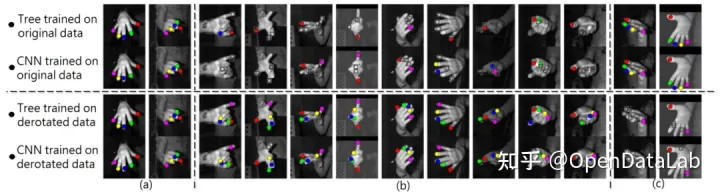

● 发布时间:2015

● 简介:HandNet 数据集,包含了 10 名参与者在RealSense RGB-D 相机前拍摄的非刚性变形的手部深度图像。其中还包含了 6D 数据,用于描述手的中心及指尖的位置方向信息。

此数据集包含训练集:202198;测试集:10000;验证集:2773。

● 下载地址:

https://opendatalab.org.cn/HO-3D

● 论文地址:

https://www.cv-foundation.org/openaccess/content_cvpr_2014/papers/Qian_Realtime_and_Robust_2014_CVPR_paper.pdf

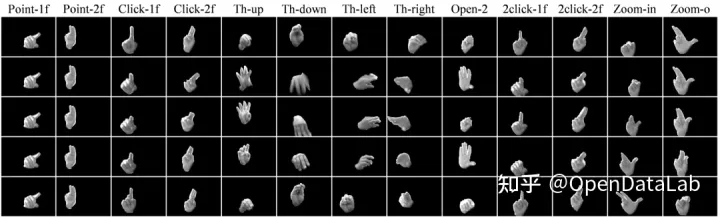

18. CSL

● 发布方:中国科学技术大学

● 发布时间:2015

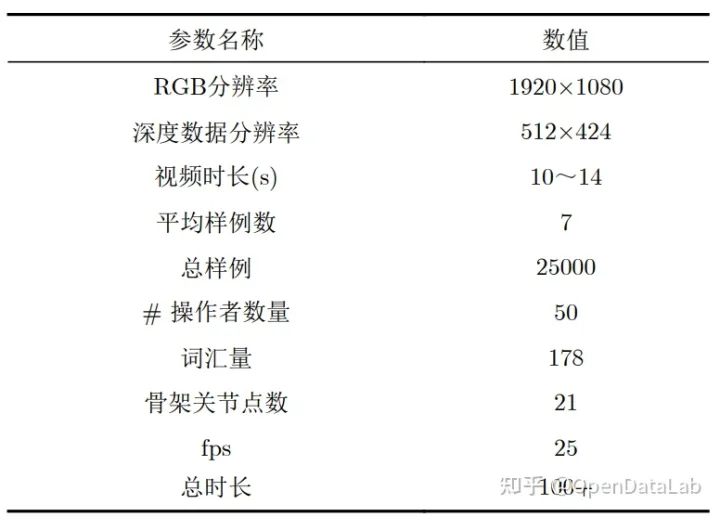

● 简介:中国手语数据集(CSL)是由中国科学技术大学自2015年起利用Kinect采集的中国手语数据集,包含25K标记的视频实例,共有超过100个时长的视频,50个操作者拍摄,每个操作者重复5次,包含RGB、深度以及骨架关节点数据,分为孤立词和连续语句,其中单词有500类,每类含250个样例, 包含21个骨架关节点坐标序列;句子有100个,共 有5000个视频,每一个句子平均包含4~8个单词。

每一个视频实例都由专业的中国手语老师进行标注。

数据集样例

● 下载地址:

https://opendatalab.org.cn/MFH

● 论文地址:

https://arxiv.org/pdf/2109.02917.pdf

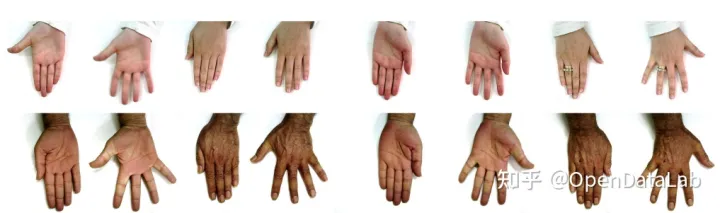

20. 11k Hands

● 发布方:约克大学、阿斯尤特大学

● 发布时间:2019

● 简介:11k Hands是一个用于性别识别和生物特征识别的详细真实信息的人类手部图像(背侧和手掌侧)的大型数据集。包含 190 位参与者的人手图片数据集,年龄在 18-75 岁之间。所有背景色均为白色,且拍照距离一致。

对应的元数据包含:● 主题 ID● 性别● 年龄● 肤色● 手的信息,即右手或左手,手侧(背侧或手掌)和逻辑指示符,用于指示手部图像是否包含附件,指甲油或不规则物。

手势实例数和手势持续时间统计

● 下载地址:

https://mks0601.github.io/InterHand2.6M/

● 论文地址:

https://arxiv.org/pdf/2008.09309.pdf

以上就是本次分享,获取海量数据集资源,请访问OpenDataLab官网;获取更多开源工具及项目,请访问OpenDataLab Github空间。另外还有哪些想看的内容,快来告诉小助手吧。更多数据集上架动态、更全面的数据集内容解读、最牛大佬在线答疑、最活跃的同行圈子……欢迎添加微信opendatalab_yunying加入OpenDataLab官方交流群。